Zwei Wege zum Bau eines KI-Sprachbots: Stitching versus Echtzeit

Die Art und Weise, wie ein KI-Sprachbot Sprache verarbeitet, bestimmt, ob er natürlich klingt oder stockend und unzuverlässig wirkt. Derzeit sind zwei Architekturen im Umlauf, und die Wahl zwischen ihnen hat Folgen für die Anruferfahrung, die Zuverlässigkeit des Systems und das, was der Bot aus einem Gespräch aufgreifen kann. Die ältere Methode verbindet drei separate Komponenten hintereinander, während die neuere Methode das gesamte Gespräch auf einmal verarbeitet.

Der klassische Ansatz: Stitching

Als die ersten Sprachbots gebaut wurden, war es sinnvoll, drei bestehende Komponenten zusammenzuschalten. Eingehende Sprache durchlief eine Sprach-zu-Text-Engine, die daraus Text machte, dann las ein Sprachmodell diesen Text und formulierte eine Antwort, und schließlich wandelte eine Text-zu-Sprach-Engine diese Antwort wieder in hörbare Sprache um. Diese Architektur wird in der Branche “Stitching” genannt, weil man drei unabhängige Systeme in eine Kette aneinander reiht.

Eine Zeit lang lieferte das brauchbare Ergebnisse, und für Teams, die kein eigenes Sprachmodell trainieren wollten, war es die einzige praktische Lösung. Doch in der Praxis zeigen sich drei Schwachstellen, weil jedes Glied in der Kette separat ausfallen kann. Die Spracherkennung kann einen Satz falsch verstehen, das Sprachmodell kann eine langsame oder falsche Antwort geben, und die Sprachsynthese kann zu einem ungünstigen Zeitpunkt ausfallen. Viele Teams bauen daher ein Backup mit einem alternativen TTS- oder LLM-Anbieter ein, damit der Bot bei Störungen weiterläuft. Das behebt den Ausfall, doch Anrufer hören plötzlich eine völlig andere Stimme und werden dadurch verwirrt, mit wem sie eigentlich sprechen.

Der zweite Nachteil wiegt möglicherweise noch schwerer. Bei Stitching sieht das Sprachmodell nur eine Text-Transkription, daher kann es den Ton, die Lautstärke, das Zögern und die Emotion des Anrufers nicht wahrnehmen. Ein verärgerter Kunde und ein zufriedener Kunde klingen für das Modell identisch, sobald ihre Worte auf dem Papier stehen, und das geht auf Kosten der Kontextsensibilität, die ein Gespräch wertvoll macht. Signale über vermutetes Alter, Muttersprache oder Stimmung gehen bei der Übersetzung in Text verloren, dabei bestimmen gerade diese Signale oft, wie ein Mitarbeiter ein Gespräch führen würde.

Der neue Ansatz: ein Echtzeit-Sprachmodell

Seit OpenAI am 24. Februar 2026 gpt-realtime-1.5 verfügbar machte, gibt es einen zweiten Weg zum Bau von Sprachbots, der in den meisten Fällen besser funktioniert. Anstelle von drei separaten Komponenten hintereinander hört und spricht ein Modell direkt, daher entfällt die gesamte Zwischenschicht von Transkription und Synthese. Das Modell versteht die Worte, den Ton und die Emotion des Anrufers gleichzeitig, sodass es direkt darauf in seiner Antwort reagieren kann. Wie flüssig das in der Praxis funktioniert, zeigt ein Demo von Charlierguo gut.

Das bringt konkrete Vorteile im täglichen Gebrauch. Es gibt nur noch einen Punkt, wo etwas schiefgehen kann, statt drei, daher sinkt die Ausfallwahrscheinlichkeit erheblich. Die Antwortzeit liegt üblicherweise unter 400 Millisekunden, daher verläuft das Gespräch natürlich ohne die Verzögerung, die beim Stitching entsteht. Mehrsprachigkeit ist eingebaut, daher wechselt dasselbe Modell mühelos zwischen Deutsch, Englisch, Niederländisch und anderen Sprachen, ohne dass Sie diesen Wechsel vorher konfigurieren müssen. Und weil das Modell Audio statt Text verarbeitet, erkennt es einen verärgerten Kunden an seiner Stimme und kann ihn direkt an einen Mitarbeiter weitergeben, ohne dass dafür ein Stichwort oder eine explizite Eskalation nötig ist.

Wann Stitching noch die richtige Wahl ist

Es gibt weiterhin einen Bereich, wo die ältere Architektur besser passt – Situationen, in denen kein Live-Gespräch stattfinden muss, sondern eine Aufnahme nachträglich analysiert wird. Wenn ein Callcenter Gespräche nachher zusammenfassen, kodieren oder auf Compliance überprüfen möchte, gibt es keine Latenz-Anforderung, und Sie können ruhig ein spezialisiertes Sprachmodell wählen. Denken Sie an ein medizinisches Sprachmodell, das Abkürzungen und Fachbegriffe im Gesundheitswesen erkennt, oder eine Sprach-zu-Text-Engine, die speziell auf einen regionalen Dialekt trainiert wurde. Die Genauigkeit bei dieser einen Komponente wiegt in solchen Szenarien schwerer als die Gesamtgesprächserfahrung, weil kein Anrufer in der Leitung sitzt und auf eine Antwort wartet.

Unsere Empfehlung

Für Unternehmen, die Live-Gespräche von einem Sprachbot abwickeln lassen möchten, raten wir in fast allen Fällen zum Echtzeit-Ansatz. Die Kombination aus schnellerer Reaktion, geringerer Anfälligkeit für Störungen, Mehrsprachigkeit ohne Konfiguration und Gespür für Ton bietet eine Anruferfahrung, die Anrufer nicht als roboterhaft erleben. Für Post-Call-Analysen und andere Szenarien, in denen die Genauigkeit einer bestimmten Komponente entscheidend ist, setzen wir weiterhin Stitching-Architekturen ein, weil diese dort noch immer das stärkste Ergebnis liefern.

Unser Team baut in beiden Architekturen

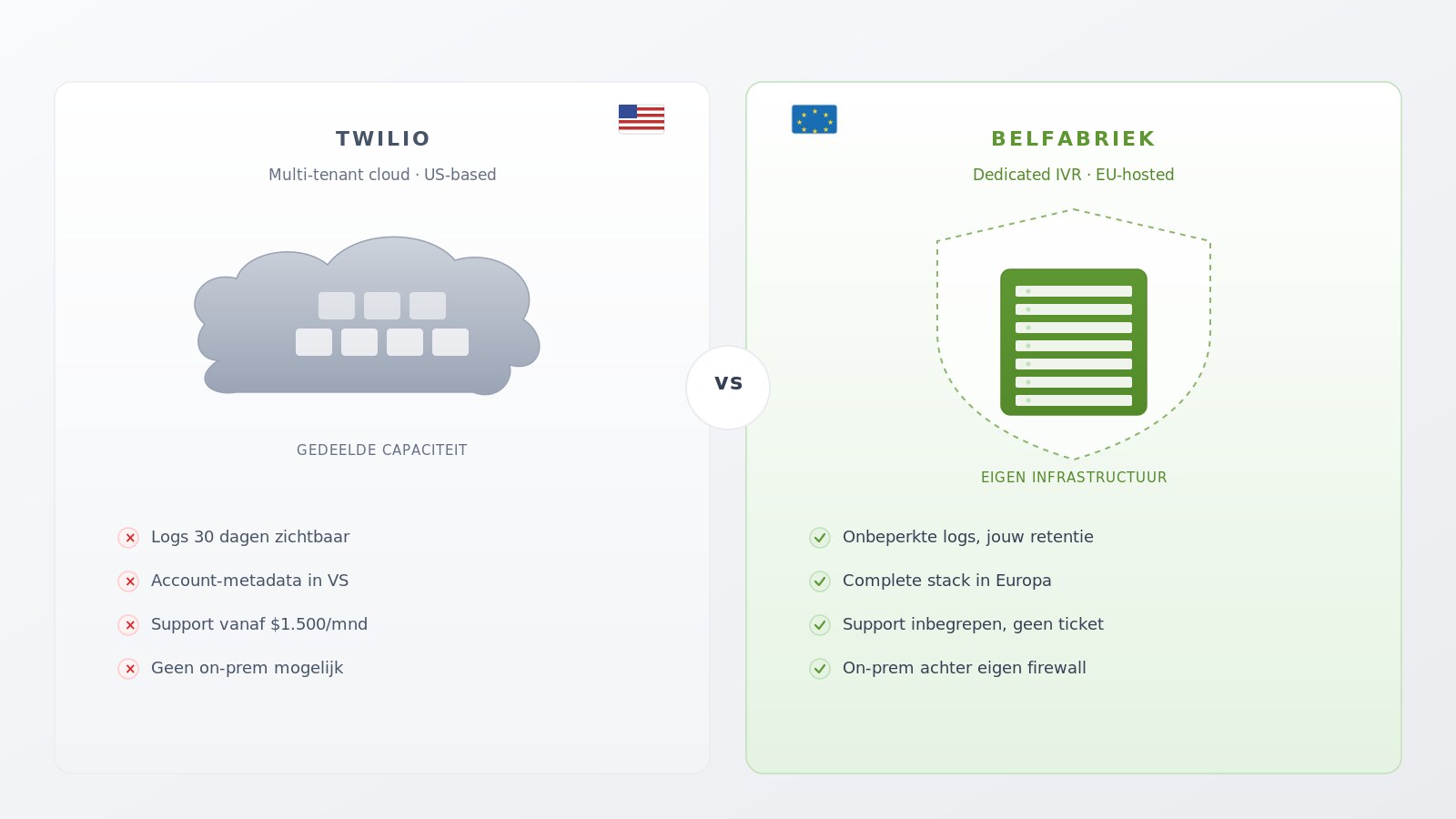

CallFactory baut Sprachbots in beiden Architekturen, je nachdem, was am besten zu Ihrem Anruffluss passt. Egal ob Sie eine vollständig verwaltete Lösung möchten, bei der unser Team alles von Anfang bis Ende einrichtet, oder lieber einen dedizierten IVR auf Ihrer eigenen Infrastruktur betreiben möchten – wir liefern DSGVO-konforme Implementierungen, die rund um die Uhr erreichbar sind.

Kontaktieren Sie unser Team, um zu besprechen, welche Architektur zu Ihren Gesprächen passt, wie die Integration mit Ihren bestehenden Systemen verläuft und innerhalb welcher Zeit der Sprachbot live gehen kann. So erhalten Sie eine klare Einschätzung der Durchlaufzeit und der Investition, und Sie können ab dem ersten Tag eingehende und ausgehende Anrufe von einem Sprachbot abwickeln lassen, der auf eine Weise spricht und zuhört, die bis vor kurzem undenkbar war.

Häufig gestellte Fragen

Stitching ist wertvoll, wenn Sie kein Live-Gespräch führen müssen, sondern eine Aufnahme nachträglich analysieren möchten. Dann haben Sie die Freiheit, ein spezialisiertes Sprachmodell zu wählen – etwa ein medizinisches Modell für Fachbegriffe im Gesundheitswesen oder eine Sprach-zu-Text-Engine, die auf einen regionalen Dialekt trainiert wurde. In solchen Fällen wiegt die Genauigkeit einer einzelnen Komponente schwerer als eine flüssige Gesprächserfahrung.

Die Antwortzeit liegt üblicherweise unter 400 Millisekunden, was einem normalen Telefonat zwischen zwei Menschen gleicht. Da keine separaten Komponenten hintereinander geschaltet sind, entfällt die Verzögerung, die beim Stitching entsteht, vollständig. Anrufer merken daher selten direkt, dass sie mit einer KI sprechen.

Ja. Echtzeit-Sprachmodelle sind mehrsprachig trainiert und können während desselben Gesprächs zwischen Deutsch, Englisch, Niederländisch und anderen Sprachen wechseln, ohne dass Sie diesen Wechsel vorher einstellen müssen. Für Unternehmen mit internationaler Kundschaft entfällt dadurch ein ganzer Konfigurationsschritt.

Wir bauen pro Projekt eine Ausweichroute ein, sodass das Gespräch bei Ausfall automatisch an einen Mitarbeiter weitergeleitet oder zu einer vorgesprochenen Nachricht führt. Der Anrufer merkt nur, dass das Gespräch übergeben wird, daher bleibt Ihr Anruffluss auch bei einer Störung auf Seite des Anbieters aufrecht.

Ja. Wir bauen den Sprachbot so auf, dass Audio und Metadaten innerhalb der Europäischen Union bleiben und dass mit allen beteiligten Parteien ein Verarbeitungsvertrag vorliegt. Für regulierte Sektoren wie Gesundheit, Banken und Versicherungen bieten wir zusätzlich eine selbst gehostete Variante, die vollständig hinter Ihrer eigenen Firewall läuft.